Un langage fluide, mais vide

L’intelligence artificielle générative impressionne par sa capacité à produire des textes cohérents, argumentés, parfois même élégants. Pourtant, il suffit d’un regard un peu attentif pour déceler, derrière l’aisance syntaxique, des confusions, des amalgames et parfois même des absurdités. La machine semble « parler », mais parle-t-elle vraiment ? Elle répond, mais comprend-elle ce qu’elle dit ?

Ce paradoxe est au cœur des interrogations soulevées par les chercheurs, formateurs et professionnels engagés dans une acculturation critique à l’IA. En effet, il ne s’agit plus seulement de se former à utiliser un outil. Il faut apprendre à le comprendre, à décoder ses limites, ses biais, ses illusions. Et surtout : à garder la main sur le sens.

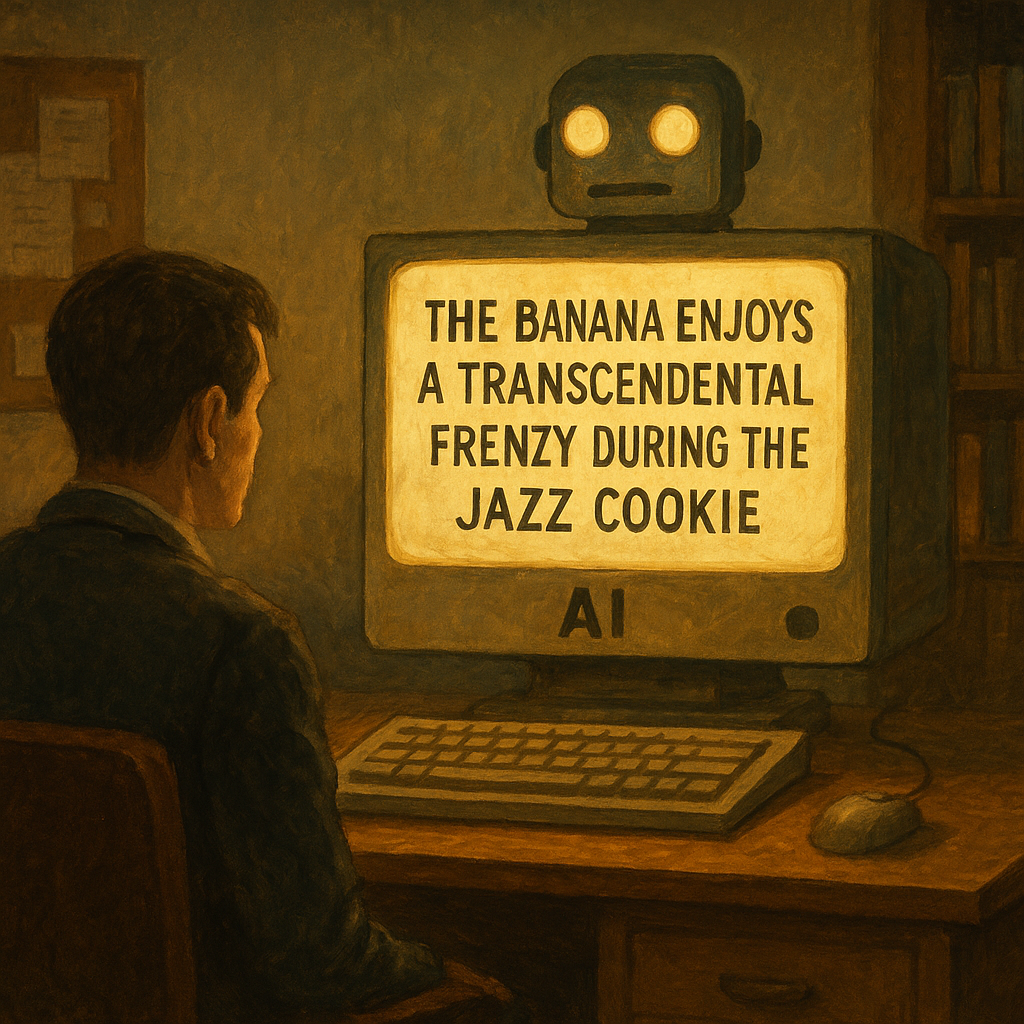

Quand la syntaxe masque le non-sens

L’une des principales limites de l’IA générative, comme ChatGPT, réside dans son fonctionnement : prédire le mot le plus probable pour poursuivre une phrase, sur la base d’un immense corpus de textes. Cela donne une impression de cohérence, mais sans ancrage sémantique réel.

Autrement dit, l’IA n’a pas d’intention, pas de conscience, pas de compréhension. Elle « écrit » sans savoir ce qu’elle dit. Elle peut associer des mots avec habileté, tout en générant des contresens ou des contradictions.

Ce phénomène, que certains appellent le « non-sens bien ordonné », interroge profondément notre rapport au langage. Quand une machine produit un texte sans sens, mais avec style, qui est responsable ? L’utilisateur qui la sollicite ? Le développeur qui l’a entraînée ? L’institution qui s’appuie sur elle ?

Des erreurs logiques invisibles au premier regard

Prenons un exemple simple : demandez à une IA la définition d’un concept complexe, comme « le moi freudien » ou « le principe de précaution ». Il est possible qu’elle génère une réponse acceptable au premier abord. Mais à la lecture attentive, vous verrez apparaître des glissements, des confusions entre écoles de pensée, ou une généralisation erronée.

Ces approximations ne sont pas des bugs. Elles sont structurelles. Et elles deviennent problématiques lorsqu’on donne à ces machines un statut d’autorité ou de vérité.

C’est ici que la formation des professionnels à l’usage de l’IA devient cruciale. Car l’enjeu n’est pas seulement technique. Il est épistémologique, éthique, politique.

L’importance de l’esprit critique face à l’IA

Dans le contexte professionnel, les adultes ont besoin d’une acculturation à l’IA qui dépasse la simple prise en main. Il s’agit d’apprendre à interroger l’outil, à le contredire, à analyser ses réponses, à traquer les incohérences.

Cela suppose de mobiliser des compétences transversales :

Maîtrise du langage,

Capacité de raisonnement,

Sens de la nuance et du doute,

Connaissance du contexte professionnel spécifique.

Car l’IA n’a pas de contexte. Elle ne sait pas ce qui est pertinent ici, maintenant, pour ce service, ce métier, cette décision. Elle fait des hypothèses probabilistes. C’est à l’humain de réintroduire le cadre, la finalité, la responsabilité.

Le piège de la standardisation du discours

L’usage massif des IA génératives dans les milieux professionnels peut entraîner un effet pervers : la normalisation du langage. Des formulations types, des discours aseptisés, une perte de style personnel.

Or, le langage n’est pas seulement un vecteur d’information. C’est un outil de singularité, d’humanité, de relation. Si toutes les réponses se ressemblent, que reste-t-il de la diversité des voix, des points de vue, des émotions ?

Evalir propose, dans ses parcours d’acculturation, des exercices qui confrontent les utilisateurs à ces questions. Par exemple : repérer les tournures automatiques d’une réponse IA, reformuler avec sa propre voix, reconstruire le sens à partir de données locales ou personnelles.

Redonner du sens aux usages professionnels de l’IA

Dans les métiers du soin, de l’enseignement, du management ou de l’administration, la tentation d’utiliser l’IA pour gagner du temps est forte. Et souvent légitime.

Mais encore faut-il se poser les bonnes questions : à quoi ce texte va-t-il servir ? Qui va le lire ? Quelle relation humaine va-t-il déclencher ? Quels sont les risques d’une erreur de sens ou de tonalité ?

Evalir ne diabolise pas l’usage des IA. Elle en propose une lecture raisonnée, située, contextualisée. Et elle donne des clés pour :

Poser un regard critique sur les productions IA,

Identifier les zones de vigilance,

Reprendre la main sur le sens et les objectifs de la communication,

Enrichir le contenu IA avec des données ou une intention humaine forte.

Une éthique du langage dans la société numérique

Ce que révèle l’usage massif de l’IA, c’est que le langage est devenu un enjeu stratégique. Derrière chaque phrase générée, il y a un modèle, un algorithme, une logique économique, voire idéologique.

Former les professionnels à l’IA, c’est donc aussi les former à une nouvelle éthique du langage. Une manière de réapprendre à penser, à écrire, à nommer, dans un monde où le mot est produit par la machine avant même d’être réfléchi.

Evalir propose aux collectivités, aux entreprises, aux organismes de formation des parcours immersifs, pédagogiques, interactifs, pour reconstruire une culture du sens dans les usages numériques.

Une plateforme dédiée à l’acculturation critique

Evalir.org s’adresse à tous les publics adultes et professionnels : agents publics, cadres, formateurs, éducateurs, acteurs de terrain, élus.

Elle propose :

Des conférences et webinaires pour poser les bases de l’acculturation,

Des ateliers d’écriture assistée par IA pour expérimenter concrètement les limites et les potentialités,

Des guides de discernement, avec des exemples concrets d’erreurs produites par l’IA,

Des parcours modulables selon les besoins et métiers.

L’objectif : permettre à chacun de devenir acteur de son rapport à l’IA, en comprenant ses forces, ses faiblesses et les enjeux de sens qui y sont liés.

Conclusion

Ce que nous révèle l’intelligence artificielle, c’est moins ce qu’elle sait faire que ce que nous devons réapprendre à faire nous-mêmes : écouter, douter, questionner, reformuler, relier.

Loin de nous éloigner du sens, l’IA peut devenir un miroir révélateur de nos propres zones d’automatisme, de nos routines langagières, de notre rapport au savoir. À condition d’apprendre à la regarder autrement.

Evalir propose de faire ce pas de côté, avec méthode, profondeur et humanité.

À Propos de Evalir

Téléphone

07 70 38 84 34

Addresse

25 bis rue de Cahors, 24200 Sarlat, France